近年来,随着人工智能概念的走红和落地,全球掀起了一股智能化风潮,为生物识别、机器视觉等产业的发展带来了巨大利益。目前,以语音技术、人脸识别为代表的生物识别技术在世界各国得到了广泛应用,并加速实现规模化商用。人工智能最重要的就是语言。语言是人工智能皇冠上的的明珠,代表着人工智能当中的最高水平。

现如今语音识别技术的发展与应用正越发成熟,智能音箱、聊天机器人、客服机器人等产品获得了消费者的普遍认可。智能语音对话已经成为目前人工智能最具挑战也最具前景的技术领域,其演进方向将是更加准确、自然、高效和友好。人工智能已经在“听”、“说”、“看”等感知领域已经达到或超越了人类的水准。

然而,近日斯坦福大学一项研究成果表明,亚马逊、苹果、谷歌、IBM和微软这五大科技巨头的语音识别系统可能存在种族差异。

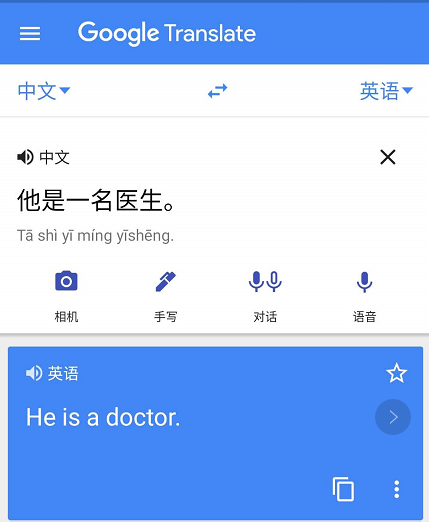

例如,这些年来,Google Translate(谷歌翻译服务)一直被人诟病存在性别偏见现象。Google Translate会默认将某些“中性”职业和特定的性别联系起来,“医生”一定是男性,而“护士”则往往是女性。AI或机器学习技术自然没有性别可谈,可性别偏见和其它社会偏见(如对年龄、职业、宗教、种族、甚至是地域的偏见和歧视)却常出现在AI产品之中。

AI不是人,为什么也会有人的偏见?

Google Translate的负责人Macduff Hughes在接受采访时解释了AI技术“自带”偏见的原因。AI和机器学习技术是通过训练数据来实现对产品和服务的支持的,而这些训练数据都是来自真实的社会场景,也就难免带有社会中既有的各种偏见或歧视,接受了这些数据的AI模型则会“继承”这些观念。

用户在使用产品时又会受到这些偏见的影响,长此以往形成恶性循环,导致以性别偏见为代表的种种社会歧视越来越根深蒂固,而此种“偏见”的文本数据越多,AI模型会变得越来越“社会化”,和人一样对事物产生固有的认知偏见。

由此可见,AI本身是不具备偏见的,AI的偏见来源于人的主观意识形态。所以针对这样的情况,相关企业就必须要重视起来,通过人为的方式进行干预。以保证语音识别系统在学习过程中接收信息的平衡性,从而尽量避免出现歧视后果。

其实在我国,也存在地方方言导致语音识别有差异的情况。从大的方面来说,北方人和南方人的发音就不尽相同,就普通话识别来说,肯定是北方人的识别准确率更高。因此,方言、发音等因素也应当被考虑在内,而不是简单地判定为种族、性别偏见。

可以看出,语音识别系统要想继续拓展市场还存在不少挑战,如果无法克服用户群体倾向性、方言和发音等硬伤,那么显然不利于语音识别产品实现进一步普及,也不利于其获得更广泛用户的认可。对于语音识别行业来说,市场前景固然广阔,但也必须努力克服眼下的困境,才能迎来真正的腾飞。AI技术是由人类创造的并塑造的,技术从业者需要像Google Translate一样,打造更公正平等的AI产品反哺社会,帮助人类向更文明的方向发展。